Roadmap de AMD Instinct MI400 y MI500: desafío directo al dominio de IA de NVIDIA

En muy poco tiempo, las GPU para inteligencia artificial han pasado de ser una curiosidad de nicho en el mundo HPC a convertirse en la mercancía más disputada de la industria de los chips. Hoy, si alguien habla de entrenar modelos de lenguaje gigantes, montar fábricas de IA o levantar nuevos centros de datos, el nombre que sale primero casi siempre es el mismo: NVIDIA. Pero AMD está claramente cansada de ser solo la alternativa. En su Financial Analyst Day 2025, la compañía enseñó una hoja de ruta mucho más agresiva, con la familia Instinct MI400 prevista para 2026 y la siguiente generación Instinct MI500 apuntando a 2027. El mensaje es sencillo: la era de la IA no debería ser un monólogo de un solo proveedor.

La apuesta central de AMD es abandonar los grandes lanzamientos «cada varios años» para adoptar un ritmo anual de actualizaciones en sus GPU de centro de datos, similar al de su rival. Las generaciones basadas en CDNA 3 y CDNA 4, como MI300X, MI325X y MI350X, ya le han abierto puertas en proyectos reales de LLM e instalaciones de supercomputación. Ahora, MI400 (CDNA 5) y MI500 (sobre una arquitectura de próxima generación CDNA Next/UDNA) están pensadas como los dos siguientes peldaños: cada escalón con más cálculo, más memoria, más ancho de banda y, sobre todo, más capacidad de escalar a nivel de rack completo.

Instinct MI400: CDNA 5, HBM4 y mirada puesta en racks de IA completos

La serie Instinct MI400 será el gran lanzamiento de AMD para 2026. Basada en la arquitectura CDNA 5, no es un simple retoque de la MI350, sino un salto claro. La compañía habla de alrededor de 40 PFLOPs en FP4 y 20 PFLOPs en FP8 por acelerador, aproximadamente el doble de lo que ofrece hoy la MI350. Esa cifra no es marketing vacío: refleja hacia dónde va el mercado, con modelos cada vez más grandes que se entrenan e infieren de forma masiva usando formatos de menor precisión para ahorrar energía y costes, pero sin renunciar a la calidad.

Sin embargo, la potencia de cálculo por sí sola no basta para domar modelos con cientos de miles de millones de parámetros. El gran golpe de efecto del MI400 está en la memoria. AMD salta a HBM4 y aumenta la capacidad de 288 GB de HBM3e en MI350 a unos contundentes 432 GB por GPU, un incremento cercano al 50 %. A eso se suma una banda de memoria anunciada de hasta 19,6 TB/s, más del doble que la generación anterior. En la práctica, esto significa que muchos modelos que hoy necesitan trocearse entre varias GPU podrán residir en menos aceleradores, reduciendo la complejidad de sharding y la sobrecarga de comunicación.

La historia no termina en el sustrato. La conectividad entre aceleradores también es una pieza clave: AMD apunta a unos 300 GB/s de ancho de banda de escala horizontal por GPU para interconectar varios Instinct dentro del mismo clúster. Y, a diferencia de otros enfoques muy cerrados, la empresa insiste en el uso de redes a escala de rack basadas en estándares, con tecnologías como UALoE, UAL y UEC. Traducido: la idea es que el cliente pueda integrar Instinct en infraestructuras ya existentes sin tener que tirar medio centro de datos para adoptar una única solución propietaria.

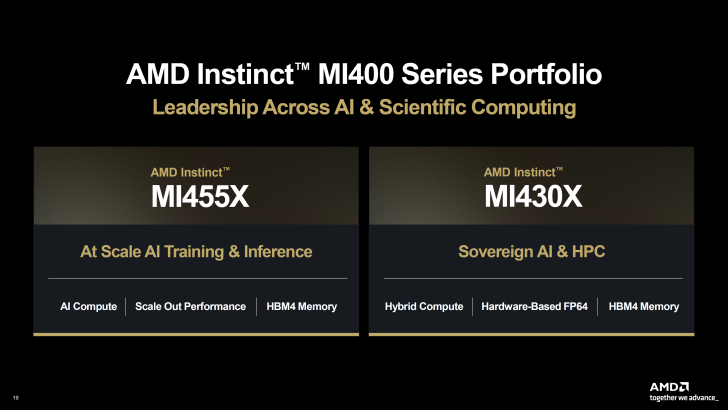

MI455X y MI430X: dos perfiles para dos tipos de clientes

Dentro de la familia MI400, AMD ha dibujado dos productos bien diferenciados. El Instinct MI455X será el buque insignia para entrenamiento de IA a gran escala y servicios de inferencia muy densos. Es la tarjeta que mirarán los hiperescaladores cuando planifiquen racks llenos de modelos de lenguaje, asistentes multimodales y pipelines de recomendación, con margen para seguir creciendo en tamaño de modelos sin rehacer cada despliegue.

El Instinct MI430X se posiciona de forma distinta. Mantiene el mismo nivel de memoria HBM4 que su hermano mayor, pero se centra en potencia FP64 y en una integración estrecha entre CPU y GPU. El objetivo son entornos de HPC clásico y la llamada «IA soberana», en los que gobiernos, laboratorios públicos, universidades o grandes bancos quieren tener capacidad de IA de primer nivel bajo su propia jurisdicción, tanto a nivel legal como físico. Allí se combinan simulaciones científicas, modelos climáticos, cargas financieras sensibles y modelos de lenguaje entrenados localmente, todo sobre una base de CPUs EPYC y GPUs CDNA 5.

AMD frente a NVIDIA Vera Rubin: más que una batalla de cifras

En las diapositivas oficiales, el cara a cara con la futura plataforma Vera Rubin de NVIDIA suena ambicioso. AMD presume de alrededor de 1,5 veces más capacidad de memoria por GPU, una banda de memoria comparable, paridad en FLOPs de FP4 y FP8, un ancho de banda similar a nivel de nodo y una ventaja de aproximadamente 1,5 veces en escala entre nodos. Si esos números se mantienen cuando el silicio llegue a los racks, desaparece parte de la sensación de que «fuera de NVIDIA no hay nada equivalente».

Pero cualquiera que haya montado un clúster sabe que las tablas de especificaciones no entrenan modelos por sí solas. Lo que decide la batalla es el sistema completo: GPUs, red, software, librerías, herramientas de orquestación y soporte. NVIDIA lleva años ofreciendo no solo chips, sino auténticas «fábricas de IA» empaquetadas, con diseños de referencia y un stack de software muy maduro. Justo en ese terreno es donde AMD tiene más trabajo por delante. La compañía sostiene que, con MI400, HBM4, interconexiones estandarizadas y un ROCm cada vez más decente, por fin puede competir no solo en papel, sino en despliegues reales de gran tamaño.

MI500 en 2027: la siguiente sacudida

Si MI400 es la entrada de AMD en la conversación de tú a tú con NVIDIA en los próximos años, la serie Instinct MI500 es el movimiento pensado para cambiar el tono del debate a partir de 2027. Los detalles concretos son escasos, pero la narrativa está clara: nueva arquitectura CDNA Next o UDNA, nuevo nodo de proceso, mayor densidad de cálculo por watt y por rack, memoria de nueva generación y un nivel de integración entre GPU, memoria y red más profundo.

En la comunidad técnica ya circulan apuestas sobre modelos intermedios, como un hipotético MI450X, e incluso sobre la posibilidad de que AMD aproveche nodos de fabricación más avanzados que los 3 nm ligados a Rubin. Es pronto para dar nada por hecho, pero el simple hecho de que se hable de eso indica hasta qué punto ha cambiado el panorama: la pregunta ya no es si AMD puede acercarse, sino en qué métricas concretas podría tomar la delantera.

¿Y los jugadores de PC en medio de la fiebre de la IA?

Mientras los inversores celebran cada nueva diapositiva de Instinct, una parte de la comunidad observa con cierta frustración: los jugadores de PC. Muchos ven a Lisa Su hablando casi exclusivamente de IA, centros de datos, Instinct y EPYC, y sienten que Radeon para gaming ha quedado en segundo plano. Con la escasez de capacidad en los nodos más avanzados, es lógico preguntarse cuántos wafers quedan disponibles para GPUs de consumo cuando MI400 y MI500 acaparan el foco.

La realidad, como casi siempre, es más matizada. Es evidente que los aceleradores de IA son hoy el negocio de mayor margen y que tanto AMD como NVIDIA van a priorizarlos. Pero al mismo tiempo, son esos proyectos los que financian la investigación en empaquetado con HBM, nuevas jerarquías de caché, técnicas de ahorro energético y redes de alta velocidad. Históricamente, ese tipo de innovación ha terminado filtrándose a las tarjetas gráficas de consumo, aunque con retraso. La propia AMD ha insinuado que sus próximas arquitecturas de GPU de juegos estarán alineadas con este roadmap más amplio de CPU y GPU hasta finales de década. Para el jugador, el corto plazo puede ser decepcionante; el medio y largo plazo, en cambio, podría traer Radeons mucho más eficientes gracias a lo aprendido en Instinct.

¿Burbuja de IA o nueva infraestructura básica?

En paralelo a la carrera técnica, sigue vivo el debate sobre si todo esto es una burbuja que terminará explotando. Resulta irónico que algunas de las voces que hace poco ridiculizaban el «hype de la IA» hoy estén analizando con lupa cuántos PFLOPs, cuánta HBM y cuánta potencia consumen las nuevas GPU. El chiste fácil dice que, si la burbuja explota, se notará primero en los presupuestos de TI y quizá en las valoraciones bursátiles, pero no en el apetito de cómputo.

AMD, desde luego, no se comporta como si el mercado fuese a desaparecer de la noche a la mañana. No se plantea una cadencia anual de aceleradores, ni se invierte en HBM4 y nuevas arquitecturas de interconexión, pensando en un capricho pasajero. Un escenario mucho más lógico es un crecimiento menos explosivo, pero sostenido, con clientes que cada vez toleran menos la dependencia de un único proveedor con poder casi monopolístico. Y es justo en ese hueco donde AMD quiere colocar a MI400 y MI500: como la opción que introduce competencia real sin obligar a rediseñar todo el centro de datos desde cero.

Conclusión: hoy roadmap, mañana competencia real

Por ahora, MI400 y MI500 viven sobre todo en presentaciones, gráficas comparativas y promesas de rendimiento. La verdadera prueba llegará cuando los primeros sistemas piloto entren en servicio en nubes públicas y supercentros de cálculo y tengan que medirse contra la combinación de hardware maduro y ecosistema software de NVIDIA. Ahí se verá si Instinct es solo un buen titular o si realmente puede sostener clústeres grandes, estables y escalables con un stack de software en el que desarrolladores y equipos de MLOps quieran trabajar a diario.

Si AMD consigue superar ese listón, el impacto irá mucho más allá de un par de récords de benchmarks. Más opciones en memoria, interconexión y arquitectura pueden reducir la dependencia de un solo actor, contener precios y acelerar el ritmo de innovación en todo el mercado. En última instancia, la cuestión ya no es quién presume de más PFLOPs en las diapositivas, sino si la era de la IA estará marcada por un casi monopolio o por una competencia abierta. Con Instinct MI400 y MI500, AMD ha dejado claro que no piensa ver el combate desde la grada; los próximos años dirán hasta qué punto puede cambiar las reglas del juego.