Anthropic acaba de encender la mecha en la guerra del hardware de inteligencia artificial con un acuerdo colosal con Google Cloud que pone a NVIDIA bajo presión. La compañía de IA anunció un contrato histórico para utilizar hasta un millón de chips TPU (Tensor Processing Units) de Google, convirtiéndose en el mayor cliente externo de estos procesadores especializados. Con más de un gigavatio de capacidad disponible para el próximo año, el trato representa un salto monumental en poder de cómputo y marca una clara declaración de independencia frente al dominio de las GPU de NVIDIA.

Durante años, NVIDIA ha reinado como la reina indiscutible del hardware para IA, gracias a su ecosistema CUDA y a la potencia de sus GPU.

Pero los tiempos cambian. A medida que crece la demanda de cómputo y se disparan los costos energéticos, compañías como Anthropic buscan alternativas más eficientes. Los TPU de Google, diseñados específicamente para tareas de aprendizaje automático, prometen una combinación ideal de rendimiento, consumo energético y costo por operación.

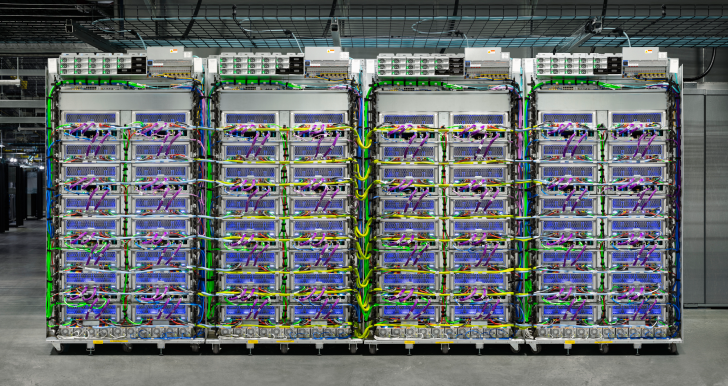

La alianza entre Anthropic y Google no es nueva. Desde 2023, Anthropic entrena sus modelos Claude sobre la infraestructura de Google Cloud. Sin embargo, esta expansión lleva la relación a un nivel sin precedentes: la empresa dispondrá de hardware dedicado, optimizado para entrenamiento masivo de modelos y respaldado por las herramientas avanzadas de Google. Para Anthropic, es una jugada estratégica; para Google, una demostración de fuerza frente a la hegemonía de NVIDIA.

Pero detrás del tono corporativo, hay una rivalidad que viene cocinándose desde hace tiempo. Anthropic ha criticado públicamente a Jensen Huang, CEO de NVIDIA, por sus políticas de precios y su monopolio en el mercado de chips. Huang no se ha quedado callado, acusando a Anthropic de ser demasiado cerrada con su ecosistema y modelos. El conflicto refleja algo más profundo: la transición de la industria hacia hardware especializado y la búsqueda de independencia tecnológica.

En una entrevista reciente, el propio Huang reconoció que los chips ASIC, como los TPU de Google o los Trainium de Amazon, representan una amenaza real para el dominio de las GPU. Aunque NVIDIA aún cierra contratos multimillonarios con OpenAI y Oracle, el movimiento de Anthropic demuestra que el mercado empieza a diversificarse. Ya no se trata solo de potencia bruta, sino de eficiencia, escalabilidad y costos sostenibles.

Expertos del sector señalan que las ventajas económicas son claras: los TPU consumen menos energía, ofrecen mayor rendimiento por dólar y reducen significativamente el costo de entrenar modelos gigantes. Además, con la infraestructura global de Google Cloud, Anthropic obtiene acceso inmediato a un entorno escalable y optimizado sin depender del volátil suministro de GPUs.

NVIDIA sigue siendo la referencia en cómputo acelerado, pero este acuerdo lanza una señal inequívoca: el futuro de la IA podría estar definido por chips especializados, no por tarjetas gráficas universales. Anthropic y Google apuestan por un nuevo paradigma, donde la eficiencia vence al músculo. Y si algo está claro, es que la batalla por el trono del silicio acaba de ponerse más intensa que nunca.

1 comentario

Jajaja Huang apostó todo a las GPU y ahora Google lo dejó en fuera de juego 😂