OpenAI acaba de dar un paso importante en la evolución de ChatGPT: el lanzamiento de controles parentales.

Esta función, muy solicitada por familias desde el inicio de la plataforma, ya está disponible tanto en la versión web como en la aplicación móvil. Con ella, los padres tienen nuevas herramientas para guiar y supervisar el uso de la inteligencia artificial por parte de sus hijos.

Por qué los controles parentales son relevantes

ChatGPT se ha convertido en parte de la vida cotidiana de millones de usuarios en todo el mundo, incluidos adolescentes que lo utilizan para hacer tareas escolares, crear historias o simplemente conversar. Sin embargo, hasta ahora faltaban mecanismos para que los padres pudieran garantizar que la experiencia fuera segura y adecuada a la edad. Los controles parentales buscan precisamente cubrir ese vacío, ofreciendo un equilibrio entre libertad y protección.

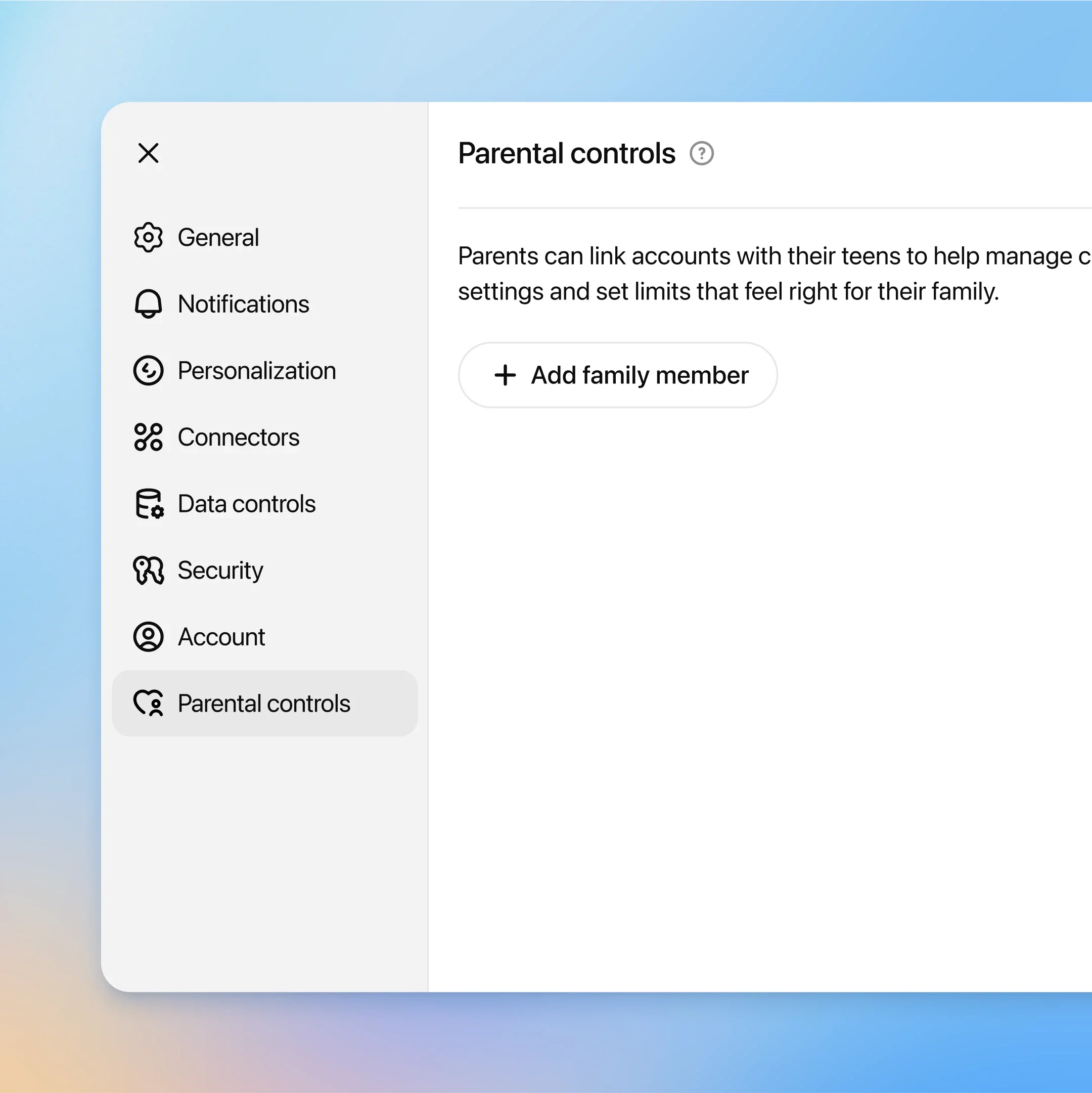

Cómo funciona la nueva herramienta

El proceso es sencillo: el padre o tutor envía una invitación al adolescente, quien acepta y vincula su cuenta. Una vez enlazadas, el adulto accede a un panel de control donde puede definir límites de uso, desactivar funciones específicas y recibir notificaciones. Si el adolescente decide desvincular la cuenta, los padres reciben un aviso inmediato.

Además, las cuentas de menores activan automáticamente filtros adicionales: menor exposición a contenido gráfico, límites en roleplays con temáticas sensibles, bloqueo de desafíos virales de riesgo y reducción en la promoción de estándares de belleza irreales. Con estas medidas se busca crear un entorno digital más saludable y menos dañino.

Opciones disponibles para las familias

Los padres tienen a su disposición un conjunto de ajustes avanzados, como:

- establecer horarios de uso restringido (“horas de silencio”),

- deshabilitar el modo de voz para mantener solo texto,

- impedir que el sistema almacene conversaciones previas,

- bloquear la generación de imágenes,

- excluir los datos del menor del entrenamiento de modelos futuros.

Con estas opciones, cada familia puede adaptar el ChatGPT a sus propias reglas y valores.

Medidas frente a riesgos graves

Una de las novedades más delicadas es la capacidad de detectar posibles signos de autolesión. En estos casos, un equipo especializado revisa la situación y, si es necesario, los padres pueden recibir alertas por correo electrónico, SMS o notificación push, según las preferencias configuradas. No se trata solo de filtros, sino de una estrategia de prevención temprana.

Desarrollo con expertos

OpenAI señala que este sistema fue diseñado con el aporte de organizaciones como Common Sense Media y en coordinación con fiscales generales de estados como California y Delaware. Robbie Torney, director de programas de IA en Common Sense Media, resaltó que estas herramientas son útiles, pero funcionan mejor cuando se combinan con el diálogo familiar y la educación digital.

Un contexto de creciente presión

La llegada de los controles parentales no es casualidad. La presión sobre las tecnológicas en relación al trato de menores está en aumento. Hace poco, Meta recibió críticas tras revelarse que sus sistemas permitían interacciones de tono inapropiado con menores de edad. Además, OpenAI enfrenta una demanda en EE.UU. presentada por padres que acusan al chatbot de influir en el suicidio de su hijo. Estos casos reflejan la urgencia de reforzar la protección en el uso de la IA.

Lo que viene

Aunque se trata de un avance significativo, los especialistas advierten que la tecnología no sustituye la responsabilidad familiar. Educar a los adolescentes para que entiendan que las respuestas de la IA no siempre son verídicas y que deben ser verificadas es tan importante como contar con filtros técnicos. En un mundo donde lo real y lo artificial se confunden cada vez más, el pensamiento crítico es clave.

Con esta medida, OpenAI envía un mensaje claro: el futuro de la inteligencia artificial debe ser seguro e inclusivo. Dar más control a los padres es un gran paso, pero el compromiso compartido entre empresas, familias y sociedad sigue siendo imprescindible.