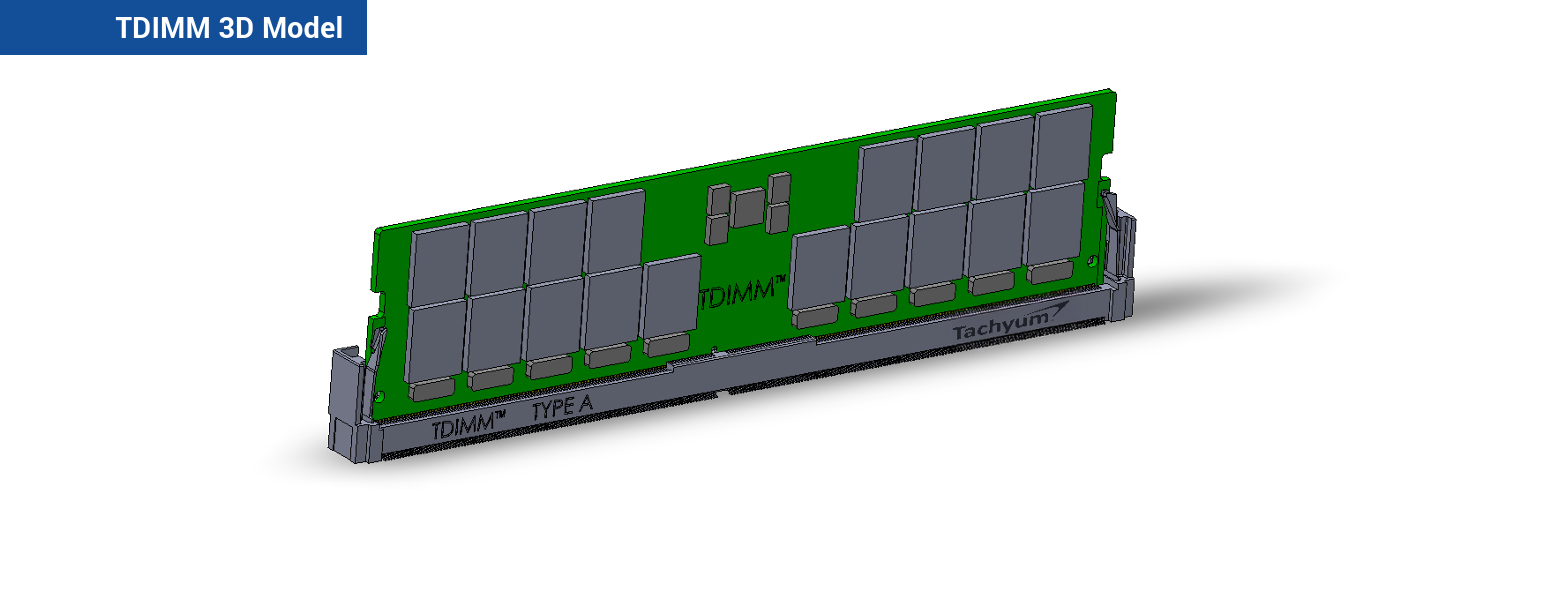

Tachyum vuelve a la conversación del hardware con una apuesta tan ambiciosa como polémica: TDIMM, un nuevo formato de módulos de memoria que promete hasta 1 TB por DIMM, más de cinco veces el ancho de banda de los RDIMM DDR5 actuales y, si uno cree a la letra sus cifras, una revolución en el coste de los centros de datos de inteligencia artificial. Sobre el papel, TDIMM se presenta como la pieza que faltaba para que los clústeres de IA dejen de estar estrangulados por la memoria y por la factura eléctrica.

Qué es TDIMM y en qué se diferencia de un RDIMM normal

TDIMM significa Tachyum DIMM.

No es simplemente otro sabor de DDR5, sino un replanteamiento del canal de memoria entre CPU y módulo. En un servidor típico, un RDIMM DDR5 expone un bus de datos de 64 bits más 16 bits para ECC, y se conecta mediante un conector de 288 pines. Tachyum rompe ese esquema: propone un bus de 128 bits para datos, mantiene los 16 bits de ECC y amplía el conector hasta 484 contactos, con una distribución distinta de señales DQS, líneas de direcciones y señales de control.

El efecto teórico es llamativo. Según Tachyum, un módulo TDIMM DDR5 puede alcanzar del orden de 281 GB/s de ancho de banda, frente a unos 51 GB/s que atribuyen a un RDIMM DDR5 convencional. Es decir, alrededor de 5,5 veces más por ranura. Parte de esa ganancia viene de algo tan sencillo como doblar la anchura del bus; el resto se atribuye a optimizaciones en la señalización y a menos sobrecarga en el protocolo. La compañía insiste en que el número total de señales sólo aumenta en torno a un 38 %, no al 100 %, lo que suena bien sobre el PowerPoint, aunque habrá que ver cómo se traduce en placas reales.

Hasta 1 TB por DIMM: densidad para clústeres de IA

La otra gran promesa del TDIMM es la capacidad. Los diseños de referencia que Tachyum ha mostrado hablan de tres escalones: módulos estándar con 256 GB, versiones más altas con 512 GB y un formato extra alto que empuja la capacidad hasta 1 TB por módulo. Para cargas de trabajo como modelos de lenguaje con cientos de miles de millones de parámetros, bases de datos en memoria o análisis masivo en tiempo real, disponer de tanta RAM local por socket cambia por completo el juego.

En la práctica, esto significa menos dependencia de soluciones de memoria distribuida, menos tráfico por las redes de alta velocidad dentro del centro de datos y menos tiempo perdido moviendo tensores de un nodo a otro. Si un servidor puede alojar muchos más datos directamente en sus DIMM, el cuello de botella se desplaza de la memoria hacia el cálculo, justo donde los fabricantes de CPU y GPU quieren estar.

El argumento del coste: menos chips DRAM, mismo volumen

Tachyum no se conforma con hablar de rendimiento; también asegura que TDIMM puede ser más barato por gigabyte que un RDIMM tradicional. La idea es que, gracias al bus más ancho y a cómo agrupan los ranks, un módulo TDIMM necesitaría aproximadamente un 10 % menos de circuitos integrados DRAM para ofrecer la misma capacidad. Con menos chips por placa, los costes de materiales bajarían y, en teoría, el precio final de cada módulo sería un 10 % inferior, a pesar del nuevo conector y de la mayor complejidad del PCB.

Es un argumento que suena razonable, pero que depende de muchos factores: del precio de la DRAM en cada ciclo, de la disposición de los fabricantes a abrazar otro formato más, y de si los OEM creen que el beneficio compensa el riesgo de un estándar joven y con un único impulsor claro.

Nueva interfaz hoy, salto a DDR6 mañana

Por supuesto, nada de esto funciona como una actualización por software. Un canal de 128 bits y un conector de 484 pines obligan a diseñar nuevas placas base y nuevos controladores de memoria en las CPUs. Tachyum intenta rebajar la ansiedad recordando que las dimensiones físicas de la plaqueta son similares a las de un DIMM DDR5 normal, de modo que los chasis, guías de aire y sistemas de refrigeración podrían reutilizarse. Aun así, desde el punto de vista de un proveedor de nube, TDIMM sigue siendo una plataforma nueva, con todo lo que eso implica en certificación, mantenimiento y soporte a largo plazo.

En su hoja de ruta, la compañía ya mira más allá del DDR5. La idea es extender el concepto TDIMM a la futura generación DDR6. Hoy, los sistemas más extremos con DDR5 alcanzan anchos de banda agregados en el rango de 6,7 TB/s, dependiendo de la configuración. Con DDR6, el sector espera aproximadamente el doble, unos 13,5 TB/s. Tachyum, en cambio, dibuja un escenario en el que los TDIMM para DDR6 llevan esa cifra hasta unos 27 TB/s por sistema hacia 2028. Es, literalmente, otra liga.

Promesas gigantes para la IA… y un tono que suena a marketing duro

Dónde más se le nota el entusiasmo a Tachyum es en los números macro. La empresa habla de centros de datos comparables a los de OpenAI que, si se construyeran sólo con tecnologías actuales, podrían requerir inversiones totales de varios billones de dólares y consumos eléctricos del orden de 250.000 megavatios. En su narrativa, una infraestructura basada en sus CPUs Prodigy combinadas con TDIMM reduciría esa escala a decenas de miles de millones y unos pocos cientos de megavatios.

En otras presentaciones, la compañía llega incluso a afirmar que, para 2028, sistemas de IA entrenados sobre “todo el conocimiento escrito de la humanidad” podrían pasar de un escenario de 8 billones de dólares y cientos de gigavatios a unos 78.000 millones y alrededor de 1 gigavatio. Son cifras tan espectaculares que muchos lectores las interpretan más como eslogan comercial que como proyección técnica seria. Falta vocabulario de prudencia – palabras como estimado, escenario o supuesto brillan por su ausencia – y eso alimenta el escepticismo.

Cómo reacciona la comunidad: curiosidad, memes y cautela

La comunidad tecnológica se ha dividido rápidamente en dos bloques. Por un lado, quienes ven en TDIMM una oportunidad real: un estándar abierto, canales más anchos, DIMM de 1 TB y la posibilidad de aliviar el cuello de botella de memoria en cargas de IA extremas. Por otro, quienes recuerdan historias como la de Rambus o los Fully Buffered DIMM, donde las promesas de revolución acabaron ahogadas en costes, consumo y complejidad de integración.

En foros y redes ya abundan los comentarios irónicos: se señala que es fácil dibujar tablas con anchos de banda astronómicos cuando uno simplemente multiplica bits en el bus, pero que la realidad de un centro de datos pasa por problemas mucho más prosaicos, como la integridad de señal en placas de varios niveles, las interferencias electromagnéticas o la gestión de calor en racks abarrotados. También hay quien se pregunta, sin rodeos, si Tachyum tiene a día de hoy algún producto físico de volumen en el mercado o si todo vive en presentaciones y comunicados de prensa.

Qué tendría que pasar para que TDIMM importe de verdad

Para que TDIMM sea algo más que una curiosidad en la historia de los estándares de memoria, Tachyum tendrá que recorrer un camino largo y caro. El primer paso es obvio: mostrar hardware funcionando. Eso significa CPUs Prodigy con controladores TDIMM reales, placas de referencia, documentación eléctrica y mecánica completa y plataformas de prueba que puedan llegar a socios y laboratorios independientes.

Después, hará falta convencer al menos a un gran fabricante de módulos para producir TDIMM en volumen y, muy probablemente, a un proveedor de nube o un laboratorio de IA para desplegar un clúster piloto. Solo con un sistema así en producción, sometido al castigo diario de cargas reales, se podrá comprobar si las promesas de 1 TB por DIMM, 5x de ancho de banda y recortes dramáticos en coste y consumo se sostienen.

Hasta que llegue ese momento, TDIMM vivirá en ese límite difuso entre visión y vaporware: una idea potente que encaja muy bien con lo que la industria dice necesitar, pero que todavía no ha demostrado que pueda superar la barrera más dura de todas, la de los racks llenos de servidores en un centro de datos real.